關鍵數字:2026年3月,Arm打破了長達36年的慣例,首次以自家品牌推出實體CPU晶片,這項舉動不僅震撼業界,更揭示了AI時代下,晶片巨頭們如何在競爭與合作之間尋求平衡的複雜策略。

📊 數據總覽:Arm在高效能運算領域的策略轉變

Arm自從在智慧型手機市場取得巨大成功後,便積極將其架構版圖擴展至PC與高效能運算(HPC)領域,其中一個重要的里程碑是富士通(Fujitsu)推出的A64FX,這款產品顛覆了Arm架構在資料中心多用於儲存而非HPC的刻板印象。然而,隨著NVIDIA CUDA GPU加速運算技術的崛起,HPC的焦點一度轉向GPU。不過,Arm並未因此卻步,反而藉由A64FX的助攻,為資料中心與HPC規劃了Arm Neoverse IP與子系統,相較消費級的Cortex架構,Neoverse具有更高的擴展性,並針對HPC需求優化了指令集。

有趣的是,儘管Arm Neoverse架構問世,但除了富士通A64FX之外,後續的Arm資料中心CPU並未成為市場絕對主角。許多客戶選擇Arm架構,多是為了降低成本或特殊功能需求,並傾向於直接使用Neoverse微架構搭配所需介面。即便NVIDIA的Grace CPU,也是基於Neoverse CPU結合NVLink,以最大化加速運算效益的方式進行設計。

數據解讀:生成式AI與代理式AI如何催生CPU新需求

NVIDIA的CUDA加速運算引發了AI革命,初期業界焦點多集中在AI模型的訓練,NVIDIA GPU因其軟體編程彈性與豐富的開發資源而佔盡優勢。然而,隨著ChatGPT到DeepSeek引領生成式AI的實用化浪潮,以及2026年OpenClaw推動的代理式AI變革,AI推論基礎設施成為一個全新的市場需求。大型業者開始積極投入加速器產品,但由於AI推論需要更高的CPU介入,一度淪為配角的CPU,又重新成為市場關注的焦點。

在此背景下,Arm AGI CPU應運而生,其核心目的正是為了因應生成式AI對CPU效能的嚴峻考驗。這款晶片本質上是Arm與Meta共同合作的成果,旨在結合Meta自研的加速晶片,發揮最大的綜效。可以說,Arm AGI CPU是一種偏向為Meta量身打造、並冠以Arm品牌的策略,其設計強調與Meta MITA加速器的完美搭配,以實現性能最大化。

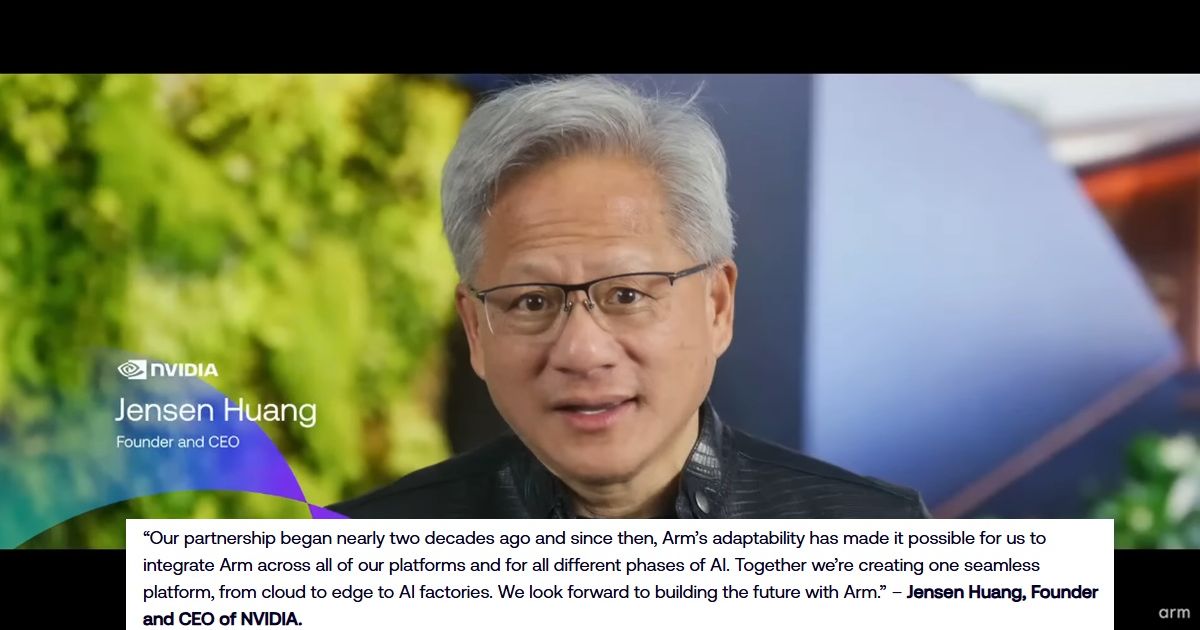

數據解讀:NVIDIA黃仁勳為何站台?深度剖析晶片巨頭的競合關係

Arm此次推出實體晶片,理論上應與其IP供應商身分產生潛在衝突,但NVIDIA執行長黃仁勳卻仍作為生態系合作夥伴代表發表演說,這背後的策略佈局值得深思。這並不意味著NVIDIA將導入Arm AGI CPU,因為從架構設計來看,Arm AGI CPU僅支援PCIe Gen 6而非NVLink,難以取代NVIDIA自研的Vera CPU。如果硬要搭配,Arm AGI CPU反而會與Intel Xeon及AMD Epyc等採用PCIe的產品產生競爭,效益不大。

事實上,NVIDIA在Hopper世代就已推廣基於Arm架構的Grace CPU,但多數產業夥伴因開發環境的熟悉度,仍傾向搭配x86 CPU。這也是NVIDIA後續在Vera CPU不再使用Neoverse CPU,改為自研的Olympus架構的關鍵。無論是NVIDIA Vera還是Arm AGI CPU,兩者目的都是解決新一代AI架構的CPU效能瓶頸,只是出發點略有不同:Vera更傾向兼顧訓練與推論的系統需求,而Arm AGI CPU則以配合Meta MITA加速器性能最大化為主要目標。

趨勢預測:雲服務業者自研策略的潛在轉向

Arm AGI CPU的推出,可能對大型雲服務業者原本的自研Arm架構處理器計畫產生深遠影響。一方面,多數雲服務業者仍需依賴Arm Neoverse架構及運算子系統;另一方面,這些業者也需投入大量資源研發客製化AI推論ASIC。Meta此次成功示範委由Arm量身打造與其系統最佳化的CPU,或許會吸引其他大型雲服務業者改變策略。

這些業者有可能將原本獨立的CPU開發團隊資源,轉向客製化ASIC團隊,並選擇將CPU需求提供給Arm,由Arm循AGI CPU模式為其操刀開發,再與自身的客製化AI ASIC結合。這不僅能降低自研CPU的成本與複雜度,也能確保CPU與AI加速器的最佳整合,進一步推動Arm架構在資料中心的普及與應用。

數據告訴我們什麼?AI晶片生態系的共榮與分化

Arm AGI CPU的問世,以及NVIDIA黃仁勳的站台,共同揭示了AI晶片市場一個既競爭又合作的複雜生態。數據顯示,儘管Arm架構陣營內部存在「同床異夢」的競合關係,但終極目標都是為了降低對x86 CPU的依賴,並提升成本效益。這促使相對x86生態系仍顯弱勢的Arm架構支持者們,努力團結以加速完善開發環境。例如,Arm此次也宣布貢獻1OU雙叢集機刀鋒伺服器參考設計與相關軟體,展現其推動生態系的決心。

我們可以預見,未來的資料中心CPU市場將會更趨向專業化與客製化。選擇NVIDIA加速方案的客戶,很可能會搭配NVIDIA的Vera CPU或x86 CPU;而選擇與Meta合作、採用MITA加速方案的業者,則不太可能捨棄Arm AGI CPU。這種分化反映了大型業者針對特定加速解決方案的需求,然而,在AI模型訓練方面,這些大型業者短期內仍難以擺脫NVIDIA的領先地位。這場CPU與AI加速器之間,既合作又競爭的生態系戰役,才剛剛拉開序幕。