當人工智慧的進化速度超乎想像,我們不禁要問:技術的發展是否也該設下明確的道德紅線?近期,大量由AI生成、將殘疾女性「物化」的寫實圖像在各大社群媒體上瘋傳,不僅累積數百萬次瀏覽,更引發英國慈善機構與身障倡議者嚴厲抨擊,直指這類內容不僅品味低劣,更涉及對身心障礙者的嚴重剝削與欺騙。

現象觀察:AI生成圖像的虛實界線模糊

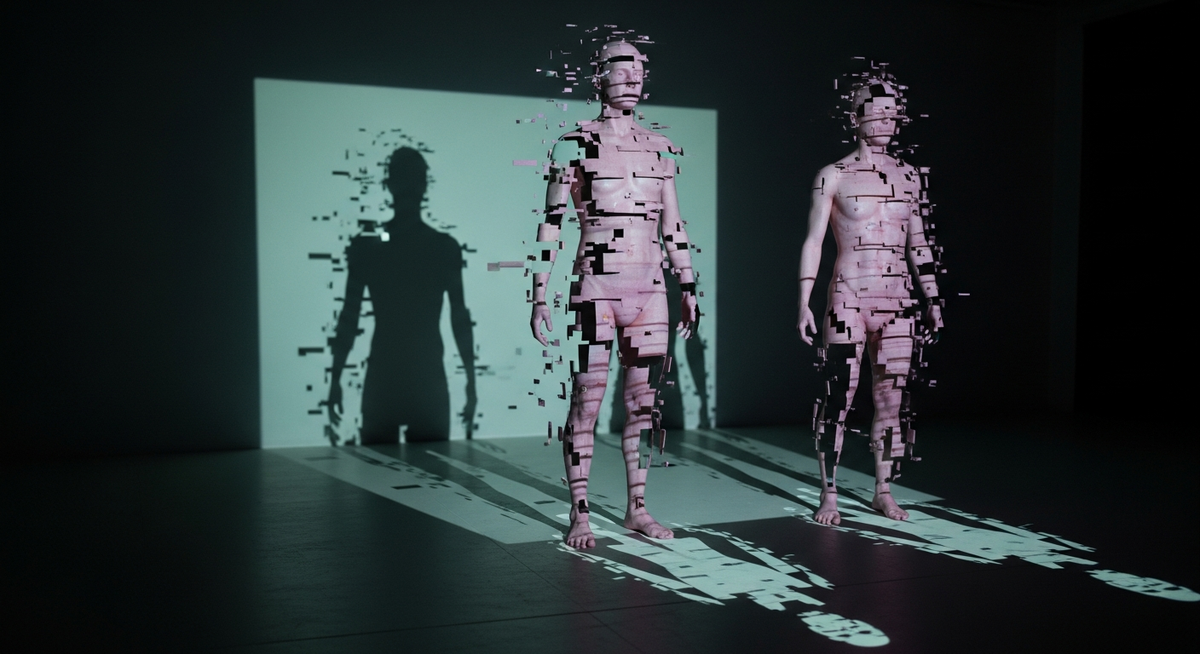

首先,我們觀察到這波AI生成圖像的浪潮,其核心問題在於高度欺騙性與真實性的扭曲。根據eNCA報導,這些人工智慧產物通常未明確標示為AI生成,使得閱聽者難以辨識其虛構本質。許多圖像透過修改非殘疾女性的真實照片,使其外觀呈現唐氏症、白斑症或白化症等遺傳性疾病或身體狀況的特徵,進而在社群平台如TikTok上廣泛流傳,甚至有影片自去年以來已累積超過四百萬次點閱。

此外,部分圖像生成平台,例如Higgsfield,甚至允許創作者為虛擬模特兒自由添加疤痕、燒傷、白化症及白斑症等身體特徵。其宣傳影片更直接表示「患有白斑症的AI網紅近期非常受歡迎」,這無疑助長了將特定身體條件視為「潮流」或「奇觀」的風氣。更有甚者,部分AI圖像與實際醫學狀況脫節,例如AI白化症模特兒在沒有眼鏡的情況下駕駛,無視白化症患者通常視力不佳的醫學現實,甚至有Instagram頁面展示穿著比基尼的連體雙胞胎AI模特兒,將嚴重的醫療狀況輕描淡寫並性化。

原因剖析:技術濫用與商業利益驅動

這類現象之所以猖獗,我們可以從幾個層面進行剖析。一方面,是AI技術的濫用與缺乏有效監管。隨著AI工具的普及與易用性提升,任何人都能輕易生成高度寫實的圖像,卻鮮少有機制能有效規範其內容倫理。另一方面,則與潛在的商業利益息息相關。英國網紅米歐(Mio)便直言,這種行為的主要原因就是為了賺錢,認為這「極其錯誤」。透過生成「吸睛」但具爭議性的圖像,經營者得以快速累積流量與關注度,進而將其轉化為商業收益,形成一種扭曲的獲利模式。

劍橋大學研究員艾莎·索比(Aisha Sobey)對此類圖像有深入觀察,她指出,這些AI生成的圖像往往呈現「高度物化的身體」和「高度性化的內容」。這種趨勢不僅反映了技術的倫理盲點,更揭示了部分創作者為了流量與經濟效益,不惜跨越道德底線,將身心障礙者的形象工具化。

影響評估:身障社群的傷害與社會倫理的衝擊

這類AI生成圖像的廣泛傳播,對身心障礙社群造成了深遠的負面影響。首先,它是一種直接的冒犯與傷害。英國唐氏症協會(The British Down’s Syndrome Association)便嚴正指出:

「這種行為是騙局,不僅品味低劣,還可能冒犯並傷害唐氏症患者。」

同樣地,白斑症協會(The Vitiligo Society)也認為,當AI創造虛構的白斑症個體並將其描繪成真實社群成員時,這已跨越到錯誤資訊的領域,並認為這是「有害且不可接受」的。其次,它加劇了身障者的物化與剝削。英國身障權利組織(Disability Rights UK)執行長卡姆蘭·馬利克(Kamran Mallick)將此趨勢比作:

「歷史上將人們當作畸形秀來取悅大眾的作法」,並斥為「剝削」。

事實上,真實世界中全球身障婦女及女孩面臨性暴力的風險本就更高,以英國為例,身障女性遭受性侵的機率幾乎是非身障女性的兩倍。這種AI生成的物化內容,無疑會進一步固化社會對身障者的錯誤認知,甚至可能助長現實世界中的歧視與暴力。美國網紅凱拉·盧德洛(Kayla Ludlow)本身患有白化症,她提到AI模特兒「沒有個性或生活,讓人無法投入感情」,並認為AI生成內容對白化症的物化「感覺不對勁」。

趨勢預測:數位倫理治理的迫切性

面對AI技術的雙面刃特性,我們必須正視數位倫理治理的迫切性。未來,社會各界應共同思考如何建立更完善的監管機制與倫理準則,以確保AI的發展能真正造福人類,而非成為剝削與歧視的工具。這包括要求平台對AI生成內容進行明確標示、提升使用者對AI內容的辨識能力、以及對濫用AI技術的行為施加適當的制裁。

同時,教育宣導也至關重要,應提升大眾對身心障礙議題的理解與尊重,從根本上消弭歧視與偏見。只有當技術發展與人文關懷並行,我們才能避免重蹈歷史上「將人們當作畸形秀」的覆轍,確保每個人在數位世界中都能獲得應有的尊嚴與尊重。